在当今数字时代,支撑超过10亿日活跃用户的微信,其后台系统无疑是世界上最庞大、最复杂的互联网服务架构之一。其卓越的稳定性和近乎实时的响应能力,背后是一套经过千锤百炼的微服务架构与精细化的运行维护服务体系。本文将深入解析微信在如此海量并发场景下的后台架构实践与运维核心。

一、 架构演进:从单体到微服务的必然之路

微信的成长史也是其技术架构的演进史。早期,相对简单的单体或粗粒度服务架构尚可应对。但随着用户量激增、功能模块(如支付、小程序、视频号等)日益复杂,单体架构在研发效率、部署灵活性和系统容错性上的瓶颈凸显。向微服务架构转型成为支撑业务爆炸式增长、实现团队高效协作的必然选择。

核心驱动力:

1. 独立性与敏捷性: 将庞大系统拆分为数百甚至上千个独立的微服务,每个服务由独立团队负责,实现技术选型、开发、部署的自治,极大提升了创新与迭代速度。

2. 弹性与可扩展性: 面对10亿DAU的洪流,微服务允许对特定功能(如春节红包、朋友圈刷新)进行快速、精准的弹性伸缩,避免资源浪费。

3. 容错与隔离性: 单个服务的故障可以被有效隔离,避免引发系统级雪崩,并通过熔断、降级等机制保障核心用户体验。

二、 10亿DAU下的微服务架构核心实践

微信的微服务架构并非简单的拆分,而是构建了一套高度定制化、适应自身极端场景的技术体系。

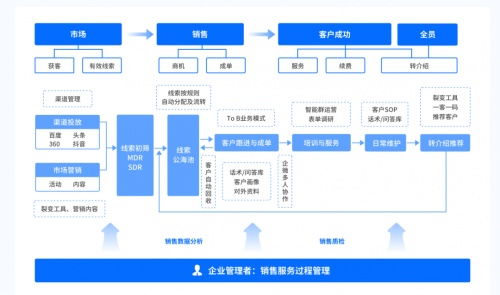

1. 服务治理与通信

- 高性能RPC框架: 自研的高性能RPC框架是微服务间的“高速公路”,针对低延迟、高并发进行了极致优化,确保服务间调用在百毫秒甚至毫秒级完成。

- 智能服务发现与负载均衡: 基于分布式配置中心和服务注册中心,实现服务的实时发现。负载均衡策略不仅考虑服务器负载,还深度结合机房、网络链路质量、业务优先级等维度。

2. 数据一致性挑战

在分布式环境下,数据一致性是巨大挑战。微信实践了多层次策略:

- 最终一致性为主: 对于大多数业务场景,采用基于消息队列的最终一致性方案,在性能与一致性间取得平衡。

- 强一致性保障: 对支付、账户等核心事务,通过优化分布式事务协议(如改良型TCC、Saga)或巧妙的分库分表策略,在保证高性能的同时满足强一致要求。

3. 海量存储与缓存

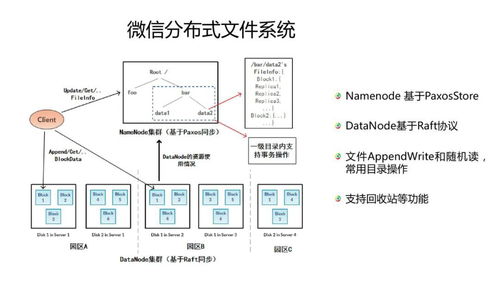

- 分级存储体系: 构建了热数据(内存缓存,如自研的分布式缓存)、温数据(高性能KV存储)、冷数据(大规模分布式文件系统/数据库)的分级存储体系。

- 缓存战略: 多级缓存(本地缓存+分布式缓存)是应对读高并发的利器。微信的缓存策略深度与业务逻辑结合,具备智能过期、穿透保护、热点探测与自动预热等能力。

4. 异步化与消息队列

消息队列是解耦微服务、实现异步处理、消峰填谷的核心组件。微信构建了高可靠、高吞吐、低延迟的消息中间件集群,支撑了朋友圈发布、消息推送、日志收集等海量异步任务。

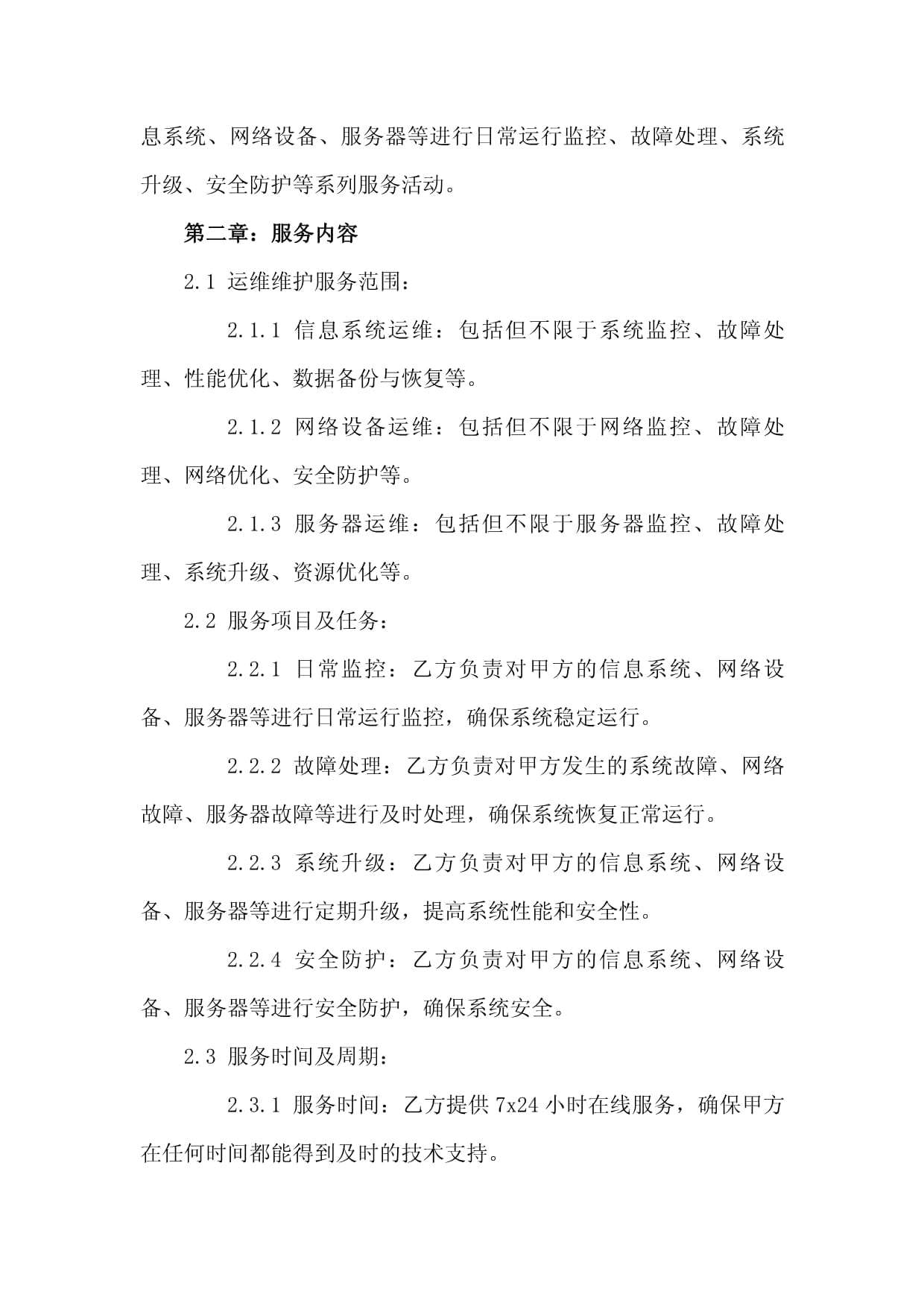

三、 信息系统运行维护服务:稳定性的基石

再优秀的架构,也离不开强大的运维体系保驾护航。微信的运维已从“救火队”演进为“稳定性工程”和“效率工程”。

1. 全链路可观测性

构建了覆盖Metrics(指标)、Logging(日志)、Tracing(链路追踪)的立体化监控体系。不仅能快速定位故障点,还能进行事前预警和性能瓶颈分析。

2. 智能化运维与故障自愈

- 自动化部署与扩缩容: 基于容器化技术(如Kubernetes)和内部平台,实现服务的自动部署、滚动升级和根据预设策略的弹性扩缩容。

- AIOps实践: 利用机器学习算法对海量监控数据进行分析,实现异常检测、根因分析、故障预测,并逐步推动常见故障的自动恢复(如流量调度、服务重启)。

3. 混沌工程与韧性建设

主动在生产环境中模拟故障(如节点宕机、网络延迟、依赖服务异常),通过“混沌工程”持续验证系统的容错能力,驱动架构不断加固,变被动应对为主动防御。

4. 容量规划与性能压测

面对“春节红包”等极端场景,进行精细化的容量规划和全链路压测,确保系统在极限压力下仍能平稳运行。

5. 安全与合规运维

将安全能力内嵌到运维流程中,包括漏洞管理、入侵检测、数据安全审计和严格的权限访问控制,保障十亿用户数据的安全与隐私。

###

微信10亿日活场景下的后台架构,是微服务理念与极端实践相结合的典范。它表明,微服务不仅仅是技术的拆分,更是组织协作模式、工程效能与稳定性保障体系的全面升级。其核心在于:以高度自动化和智能化的运维平台为底座,构建一个具备弹性、可观测、高可用的分布式服务生态系统,从而在业务的海量增长与复杂变化中,始终保持稳固与敏捷。 这套实践为行业提供了宝贵经验:在追求技术先进性的必须将系统的可运维性、可观测性和韧性设计置于架构的核心地位。